欧氏距离和余弦相似度

两者相同的地方,就是在机器学习中都可以用来计算相似度,但是两者的含义有很大差别,以我的理解就是:

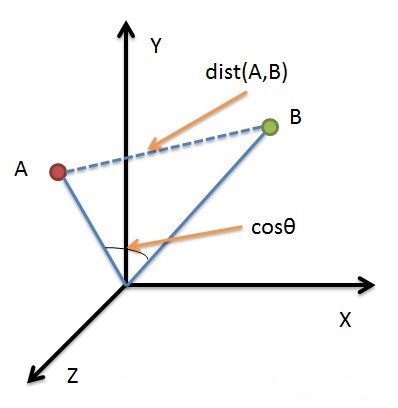

- 前者是看成坐标系中两个 点 ,来计算两点之间的 距离 ;

- 后者是看成坐标系中两个 向量 ,来计算两向量之间的 夹角 。

- 前者因为是 点 ,所以一般指 位置 上的差别,即 距离 ;

- 后者因为是 向量 ,所以一般指 方向 上的差别,即所成 夹角 。

如下图所示:

数据项A和B在坐标图中当做点时,两者相似度为距离dist(A,B),可通过欧氏距离(也叫欧几里得距离)公式计算:

$$dist(X,Y)=\sqrt{\sum_{i=1}^{n}(X_i-Y_i)^2}$$

当做向量时,两者相似度为cosθ,可通过余弦公式计算:

$$cos\theta = \frac{\sum_{i=1}^{n}(A_i \times B_i)}{\sqrt(\sum_{i=1}^{n}(A_i)^2) \times \sqrt(\sum_{i=1}^{n}(B_i)^2)}= \frac{A^T \cdot B}{||A||\times ||B||} $$

假设$||A||$、$||B||$表示向量A、B的L2范数,例如向量[1,2,3]的2范数为:

$$\sqrt{1^2+2^2=3^3} = \sqrt{14}$$

numpy中提供了范数的计算工具: linalg.norm()

所以计算$cosθ$起来非常方便(假定A、B均为列向量):

1 | |

因为有了linalg.norm(),欧氏距离公式实现起来更为方便:

1 | |

关于归一化:

因为余弦值的范围是 [-1,+1] ,相似度计算时一般需要把值归一化到 [0,1],一般通过如下方式:

$$sim = 0.5 + 0.5 * \cosθ $$

若在欧氏距离公式中,取值范围会很大,一般通过如下方式归一化:

$$sim = \frac{1}{1+dist(x,y)}$$

说完了原理,简单扯下实际意义,举个栗子吧:

例如某T恤从100块降到了50块(A(100,50)),某西装从1000块降到了500块(B(1000,500))

那么T恤和西装都是降价了50%,两者的价格变动趋势一致,余弦相似度为最大值,即两者有很高的 变化趋势相似度

但是从商品价格本身的角度来说,两者相差了好几百块的差距,欧氏距离较大,即两者有较低的 价格相似度。

参考:欧氏距离和余弦相似度

本博客所有文章除特别声明外,均采用 CC BY-SA 4.0 协议 ,转载请注明出处!